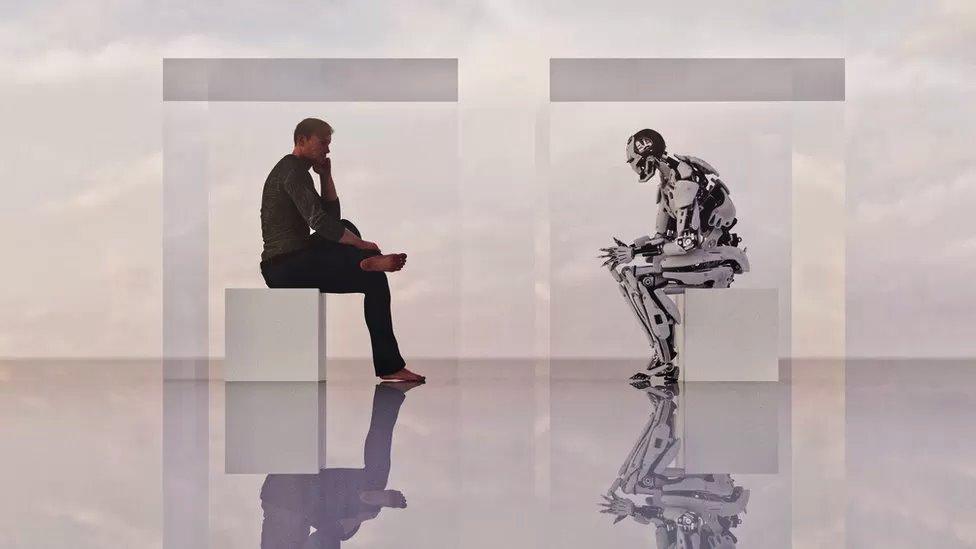

หัวหน้าทีมพัฒนา โอเพนเอไอ (OpenAI) และ กูเกิลดีปไมด์ (Google Deepmind) ออกมาเตือนว่า ปัญญาประดิษฐ์ หรือเอไอ (Artificial Intelligence – AI) อาจนำไปสู่การสูญพันธุ์ของมนุษยชาติ แล้วเครื่องจักรจะมาแทนที่มนุษย์อย่างเราได้อย่างไร

นับแต่เริ่มเปิดใช้งานเมื่อเดือน พ.ย. 2022 แชทจีพีที (ChatGPT) แชทบอทที่ใช้ปัญญาประดิษฐ์ตอบคำถาม สร้างข้อความ หรือกระทั่งสร้างรหัสคอมพิวเตอร์ (โค้ด) ตามความต้องการของผู้ใช้งาน ได้กลายเป็นแอปพลิเคชันบนอินเทอร์เน็ตที่เติบโตอย่างรวดเร็วที่สุดในประวัติศาสตร์

รายงานของ เซนเซอร์ทาวน์ (Sensor Town) บริษัทตรวจสอบด้านเทคโนโลยี ระบุว่า เพียง 2 เดือน มีผู้ใช้งาน แชทจีพีที ทะลุกว่า 100 ล้านคนแล้ว ทั้งที่ อินสตาแกรม ต้องใช้เวลาถึง 2 ปีครึ่งถึงบรรลุเป้าหมายนั้น

ความนิยมอย่างกว้างขวางของ แชทจีพีที ซึ่งพัฒนาโดย โอเพนเอไอ บริษัทเทคโนโลยีที่ ไมโครซอฟต์ เป็นผู้สนับสนุนทางการเงิน ได้จุดประกายคำถามถึงผลกระทบของเอไอที่จะมีต่ออนาคตของมวลมนุษยชาติ

นักวิชาการและผู้เชี่ยวชาญด้านเอไอหลายสิบคน ร่วมลงชื่อในแถลงการณ์ที่เผยแพร่ทางเว็บไซต์ของศูนย์ความปลอดภัยปัญญาประดิษฐ์ (Centre for AI Safety) โดยเนื้อหาตอนหนึ่งระบุว่า “การลดความเสี่ยงต่อการสูญพันธุ์จากเอไอ ควรได้รับความสำคัญในระดับโลก ควบคู่ไปกับความเสี่ยงระดับสังคมอื่น ๆ เช่น โรคระบาด และสงครามนิวเคลียร์”

แต่ก็มีบางคนที่มองว่า นี่เป็นความกลัวที่มากจนเกินไป

เลียนแบบคน

ข้อความ (ตั้งแต่เรียงความ บทกวี และเรื่องตลก ไปจนถึงรหัสคอมพิวเตอร์) และรูปภาพ (เช่น ไดอะแกรม ภาพถ่าย และงานศิลปะ) ที่ผลิตโดยเอไอ เช่น แชทจีพีที, ดอล-อี (DALL-E), บาร์ด (Bard) และ อัลฟาโค้ด (AlphaCode) อาจแยกแทบไม่ออกจากผลงานที่รังสรรค์โดยมนุษย์

เจค ออชินโคลส ส.ส. พรรคเดโมแครต เปิดข้อมูลกลางรัฐสภาของสหรัฐฯ ว่า นักเรียนได้ใช้เอไอเหล่านี้ทำการบ้าน ส่วนนักการเมืองก็ใช้มันเพื่อร่างสุนทรพจน์

ขณะที่บริษัทด้านเทคโนโลยียักษ์ใหญ่อย่าง ไอบีเอ็ม ระบุว่า จะเลิกจ้างงานราว 7,800 ตำแหน่ง แล้วใช้ไอเอมาทำแทน

เราเสียใจที่คงต้องบอกคุณว่า อันที่จริง เราเพิ่งอยู่ในขั้นแรกของเอไอเท่านั้น เนื่องจากนักวิทยาศาสตร์บางส่วนชี้ว่า ยังมีอีกเอไอยังก้าวหน้าไปได้อีก 2 ขั้น ที่อาจคุกคามความอยู่รอดของมนุษยชาติ

และนี่คือระดับของเอไอทั้ง 3 ขั้น

1. ปัญญาประดิษฐ์เชิงแคบ – Narrow Artificial Intelligence (NAI)

เอไอเชิงแคบ หรือบางครั้งเรียกว่า “เอไออ่อน” (Weak AI) มุ่งเน้นที่งานแบบครั้งเดียวจบ เป็นกระบวนการทำงานแบบซ้ำ ๆ ตามหน้าที่ที่นักพัฒนากำหนดเอาไว้

โดยทั่วไป เอไอจะเรียนรู้จากข้อมูลจำนวนมาก เช่น จากอินเทอร์เน็ต แต่พวกมันเรียนรู้ได้จำกัด ตามขอบเขตที่ถูกโปรแกรมไว้

ตัวอย่างเช่น โปรแกรมหมากรุกที่มันสามารถเอาชนะแชมป์โลกได้ แต่เอไอตัวเดียวกัน ไม่สามารถทำงานอื่น ๆ ได้

สมาร์ทโฟน เต็มไปด้วยแอปพลิเคชันที่ใช้เทคโนโลยีลักษณะนี้ ไม่ว่าจะเป็น แผนที่ระบุตำแหน่ง (จีพีเอส) โปรแกรมเล่นเพลง และวิดีโอ ที่รู้จักรสนิยมของคุณ และคอยให้คำแนะนำผู้ใช้งาน

หรือแม้แต่ระบบที่ซับซ้อนขึ้นอย่าง รถยนต์ไร้คนขับ และแชทจีพีที ก็เป็นรูปแบบหนึ่งของเอไอเชิงแคบที่ไม่สามารถทำงานนอกบทบาทที่ได้รับมอบหมาย ไม่สามารถตัดสินใจด้วยตัวเอง

อย่างไรก็ตาม ผู้เชี่ยวชาญบางส่วนเชื่อว่า ระบบที่ติดตั้งโปรแกรมให้เรียนรู้อัตโนมัติ เช่น แชทจีพีที หรือ ออโตจีพีที (AutoGPT) สามารถก้าวไปสู่ขั้นต่อไปของการพัฒนาขั้นต่อไปได้

2. ปัญญาประดิษฐ์ทั่วไป – Artificial General Intelligence (AGI)

เอไอ จะบรรลุถึงขั้นนี้ หลังมันสามารถใช้สติปัญญา แบบเดียวกับที่มนุษย์ทำได้

ขั้นที่ 2 ของเอไอนี้ รู้จักในฐานะ “เอไอแข็ง” (Strong AI)

ในเดือน มี.ค. 2022 ผู้เชี่ยวชาญด้านเทคโนโลยีกว่าพันคนเรียกร้องให้ “ห้องปฏิบัติการเอไอทั้งหมดหยุดพัฒนาและฝึกระบบเอไอที่ทรงพลังกว่า GTP-4” แชทบอทเวอร์ชันล่าสุดของแชทจีพีที ชั่วคราวเป็นเวลาอย่างน้อย 6 เดือน

“ระบบเอไอที่มีปัญญาเทียบเคียงกับมนุษย์ สามารถก่อให้เกิดความเสี่ยงอันใหญ่หลวงต่อสังคมและมนุษยชาติ” จดหมายเปิดผนึกของผู้มีบทบาทด้านปัญญาประดิษฐ์ ระบุ

จดหมายดังกล่าวเผยแพร่โดยสถาบันอนาคตแห่งชีวิต (Future of Life Institute) โดยมีบรรดาผู้เชี่ยวชาญด้านเอไอ และผู้บริหารบริษัทเทคโนโลนีชั้นนำ ร่วมลงชื่อ เช่น สตีฟ วอซเนียก ผู้ก่อตั้งแอปเปิล และ อีลอน มัสก์ ประธานผู้บริหารของเทสลา ซึ่งเป็นหนึ่งในผู้ร่วมก่อตั้ง โอเพนเอไอ ก่อนลาออกจากคณะกรรมการบริหาร

จดหมายเปิดผนึกระบุว่า หากบริษัทต่าง ๆ ปฏิเสธที่จะหยุดโครงการพัฒนาเอไอ “รัฐบาลควรเข้ามามีส่วนร่วมและกำหนดข้อตกลงชั่วคราว” เพื่อให้สามารถออกแบบและดำเนินมาตรการด้านความปลอดภัยได้

“โง่พอ ๆ กับที่มันฉลาด”

คาริสสา เวลิซ จากสถาบันจริยธรรมด้านเอไอแห่งมหาวิทยาลัยออกซ์ฟอร์ด เป็นอีกคนที่ลงนามในจดหมายเปิดผนึกดังกล่าว แต่เธอเชื่อว่า ถ้อยแถลงในภายหลังของศูนย์ความปลอดภัยเอไอ (Center for AI Safety) ที่ออกคำเตือนเรื่องการสูญพันธุ์ของมนุษย์นั้น “ไปไกลเกินไป” จึงตัดสินใจไม่ลงนามในแถลงการณ์ฉบับนั้น

“ประเภทของไอเอที่เรากำลังสร้างในขณะนี้ โง่พอ ๆ กับฉลาด” เธอกล่าวกับบีบีซี และขยายความว่า หากใครลองใช้ แชทจีพีที หรือเอไออื่น ๆ จะสังเกตเห็นว่ายังมีข้อจำกัดที่สำคัญมาก ๆ

ทว่าสิ่งที่เธอกังวลคือ เอไอสามารถปลอมแปลงข้อมูลที่ผิดพลาดได้ในอัตราที่สูงมาก

“การเลือกตั้งของสหรัฐฯ ที่จะเกิดขึ้นในปี 2024 แพลตฟอร์มสำคัญ ๆ อย่างทวิตเตอร์ และอื่น ๆ ได้ไล่ทีมงานด้านจริยธรรมและความปลอดภัยด้านเอไอของบริษัทออกไป ฉันกังวลเรื่องนี้มากกว่า” เวสิซ กล่าว

รัฐบาลสหรัฐฯ เอง ก็ยอมรับถึงภัยคุกคามจากเอไอ “เอไอเป็นหนึ่งในเทคโนโลยีที่ทรงพลังที่สุดในยุคนี้ เราจำเป็นต้องใช้โอกาสที่ยังมีอยู่ในตอนนี้ เพื่อลดความเสี่ยงจากมัน” แถลงการณ์ที่ออกโดยทำเนียบขาว ระบุ

สภาคองเกรสสหรัฐฯ ได้เรียกตัวประธานเจ้าหน้าที่บริหารของบริษัท โอเพนเอไอ คือ แซม อัลต์แมน ขึ้นให้การเพื่อตอบคำถามเกี่ยวกับ แชทจีพีที เมื่อไม่นานมานี้

ระหว่างการขึ้นให้การ อัลต์แมน ระบุว่า “มันสำคัญมาก” ที่รัฐบาลควรเข้ามาควบคุมดูแลอุตสาหกรรมนี้ เพราะเอไอ “ทรงพลังมากขึ้นเรื่อย ๆ”

คาร์ลอส อิกนาซิโอ กูเทียร์เรซ นักวิจัยด้านนโยบายสาธารณะแห่งสถาบันอนาคตแห่งชีวิต อธิบายกับบีบีซีว่า หนึ่งในความท้าทายอันยิ่งใหญ่จากเอไอ คือ “ไม่มีคณะผู้เชี่ยวชาญในการตัดสินใจว่าจะควบคุมมันอย่างไร”

และนั่น นำเราไปสู่ขั้นที่ 3 ที่เป็นเอไอขั้นสุด

3. ปัญญาประดิษฐ์ที่มีสติปัญญาและความสามารถเหนือกว่ามนุษย์ – Artificial Superintelligence (ASI)

โดยทฤษฎี เมื่อเราไปถึงขั้นที่ 2 ของเอไอแล้ว (AGI) มนุษยชาติก็จะก้าวกระโดดไปสู่สถานการณ์ที่เอไอเริ่มฉลาดกว่าสมองของมนุษย์

นิค บอสตรอม นักปรัชญาและผู้เชี่ยวชาญด้านเอไอแห่งมหาวิทยาลัยออกซ์ฟอร์ด นิยามความฉลาดล้ำของเครื่องจักรเอาไว้ว่า เป็นความฉลาดที่ “มีประสิทธิภาพเหนือกว่าสมองที่ยอดเยี่ยมที่สุดของมนุษย์ในเกือบทุกด้าน รวมถึงความคิดสร้างสรรค์ทางวิทยาศาสตร์ ความรู้เชิงภูมิปัญญาทั่วไป และทักษะทางสังคม”

กูเทียร์เรซ อธิบายว่า “การที่มนุษย์จะเป็นวิศวกร พยาบาล หรือนักกฎหมายได้ ต้องศึกษาเป็นเวลานาน แต่ประเด็นคือ ปัญญาประดิษฐ์ทั่วไป [สามารถ] พัฒนาตัวเองได้อย่างต่อเนื่องในเวลาที่เราทำไม่ได้”

นวนิยายวิทยาศาสตร์

แนวคิดว่า เอไอจะทำให้มนูษย์สูญพันธุ์ มีที่มาย้อนไปถึงพล็อตภาพยนตร์เรื่อง The Terminator ซึ่งเครื่องจักรได้เริ่มสงครามนิวเคลียร์เพื่อทำลายล้างมนุษยชาติ

อาร์วินด์ นารายานัน นักวิทยาศาสตร์คอมพิวเตอร์แห่งมหาวิทยาลัยพรินซ์ตัน บอกบีบีซีก่อนหน้านี้ว่า สถานการณ์ภัยพิบัติที่เหมือนหนังไซไฟนั้นไม่สมจริง “เอไอในปัจจุบัน ไม่มีความสามารถเพียงพอที่ในการทำความเสี่ยงเหล่านี้ให้เกิดขึ้นจริง แต่ผลที่เกิดขึ้นคือ มันเบี่ยงเบนความสนใจของมนุษย์ไปจากอันตรายระยะใกล้ของเอไอ”

ในขณะที่มีข้อถกเถียงมากมายว่า เครื่องจักรสามารถฉลาดรอบด้านอย่างมนุษย์จริงหรือไม่ โดยเฉพาะเมื่อพูดถึงความฉลาดทางอารมณ์ ที่สร้างความกังวลใจให้แก่ผู้คนที่เชื่อว่าเราใกล้บรรลุ ขั้นสองของเอไอ แล้ว

ไม่นานมานี้ เจฟฟรีย์ ฮินตัน ผู้มีฉายาว่า “เจ้าพ่อแห่งปัญญาประดิษฐ์” ผู้บุกเบิกการสอนเครื่องจักรให้เรียนรู้จากประสบการณ์ ได้ออกมาเตือนในการให้สัมภาษณ์กับบีบีซีว่า เราอาจเข้าใกล้ฉากสำคัญนั้นแล้ว

“ตอนนี้ [เครื่องจักร] ยังไม่ฉลาดเท่าเรา เท่าที่ผมเห็นนะ แต่คิดว่าอีกไม่นาน มันอาจจะฉลาดกว่านี้” ชายวัย 75 ปีที่เพิ่งเกษียณจากกูเกิล กล่าว

แถลงการณ์ลาออกจากกูเกิลของนายฮินตัน ที่ส่งถึงนิวยอร์กไทมส์ ระบุว่า เขารู้สึกเสียใจกับงานที่ทำอยู่ เพราะกลัวว่า “บุคคลที่ไม่ดี” จะใช้เอไอทำ “สิ่งเลวร้าย”

เขายกตัวอย่าง “ฉากทัศน์ฝันร้าย” นี้ให้แก่บีบีซี โดยกล่าวว่า “ลองนึกภาพบุคคลที่เลวร้ายอย่าง [ประธานาธิบดีรัสเซีย วลาดิเมียร์] ปูติน ตัดสินใจให้หุ่นยนต์สามารถสร้างเป้าหมายย่อย ๆ ของตนเองได้”

ในที่สุดเครื่องจักรก็จะสามารถ “สร้างเป้าหมายย่อย เช่น ‘ฉันต้องการมีพลังมากกว่านี้’ ซึ่งก่อให้เกิดความเสี่ยง” เขาเตือน

อย่างไรก็ตาม ฮินตันเห็นว่า ในระยะสั้น เอไอจะให้ประโยชน์มากกว่าความเสี่ยง ดังนั้น จึงไม่คิดว่าเราควรหยุดพัฒนาสิ่งนี้

สูญพันธ์ หรือ เป็นอมตะ

สตีเฟน ฮอว์กิง นักจักรวาลวิทยาและนักฟิสิกส์ชาวอังกฤษ เคยเตือนว่า “การพัฒนาปัญญาประดิษฐ์เต็มรูปแบบ อาจหมายถึงการสิ้นสุดของเผ่าพันธุ์มนุษย์”

นักฟิสิกส์ชื่อดังให้สัมภาษณ์บีบีซีเมื่อปี 2014 ก่อนที่เขาจะเสียชีวิตในอีก 4 ปีต่อมา ว่า

“เครื่องจักรที่มีความฉลาดระดับนี้ อาจอยู่เหนือการควบคุมของมนุษย์ เพราะพวกมันอาจพัฒนาตนเอง จนเปลี่ยนรูปแบบไป และมนุษย์ที่มีพัฒนาการทางด้านชีววิทยาเชื่องช้ากว่า อาจต้องยอมจำนนให้กับเอไอในที่สุด” ฮอว์กิง กล่าว

หุ่นยนต์จิ๋ว และ ความเป็นอมตะ

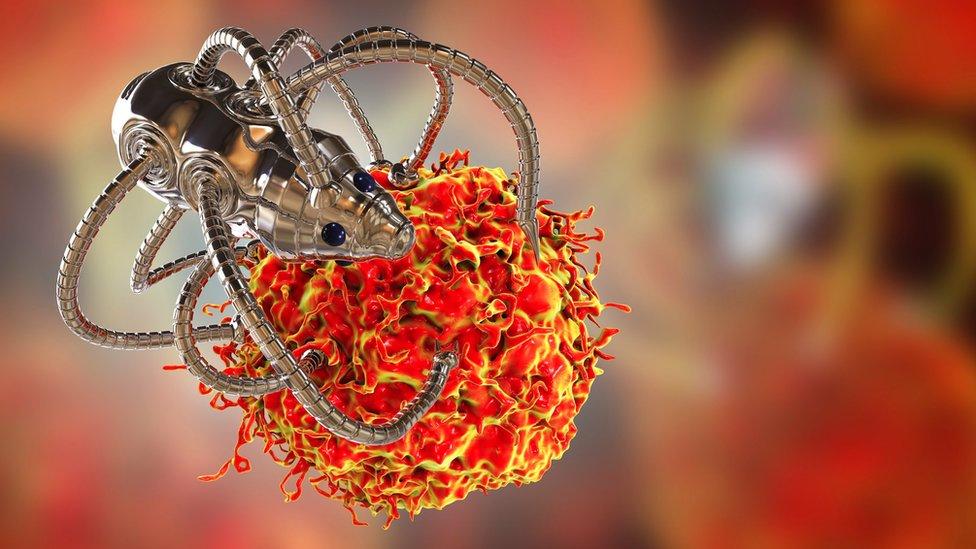

เรย์ เคิร์ซไวล์ นักประดิษฐ์แห่งอนาคต นักวิจัยด้านเอไอของกูเกิล เชื่อว่า มนุษย์จะสามารถใช้เอไอที่ฉลาดล้ำเพื่อเอาชนะอุปสรรคทางชีวภาพได้

ในปี 2015 เขาทำนายว่า ภายในปี 2023 มนุษย์จะสามารถบรรลุความเป็นอมตะได้ จากการพัฒนานาโนบอต (หุ่นยนต์ขนาดจิ๋ว) ที่ทำงานภายในร่างกายของเรา คอยซ่อมแซม ฟื้นฟูเสียหาย หรืออาการความเจ็บป่วยใด ๆ

การกำกับดูแลเอไอ

คาร์ลอส อิกนาซิโอ กูเทียร์เรซ เห็นด้วยว่า กุญแจสำคัญคือการสร้างระบบการกำกับดูแลเอไอ และให้ “ลองจินตนาการถึงอนาคตที่สิ่งหนึ่งมีข้อมูลมากมายเกี่ยวกับทุกคนบนโลกนี้ และรู้จักนิสัยของพวกเขา (ต้องขอบคุณการค้นหาข้อมูลทางอินเทอร์เน็ต) ที่มันสามารถควบคุมเราในแบบที่เราคาดไม่ถึง”

เขาบอกว่า สถานการณ์ที่แย่ที่สุด ไม่ใช่สงครามระหว่างมนุษย์กับหุ่นยนต์ “สิ่งที่เลวร้ายที่สุดคือ เราไม่รู้ว่าเรากำลังถูกบงการ เพราะเรากำลังแบ่งปันโลกใบนี้ให้กับสิ่งมีชีวิตที่ฉลาดกว่าเรามาก”

รายงานเพิ่มเติมโดย แอนดรูว์ เว็บบ์ และ คริส วอลแลนซ์